DeepSeek 测评:V4 到底强不强,值不值得用?

DeepSeek V4 一出来,讨论热度立刻就上来了。有人说它是开源阵营里的新一代狠角色,也有人觉得它在编程和多模态上还不够能打。结合官方公开资料和 V2EX 的一线使用反馈,这篇文章就来聊聊:DeepSeek V4 到底强在哪、短板在哪、适合什么人用。

DeepSeek 测评:V4 到底强不强,值不值得用?

先说结论

如果只用一句话总结,我会这样评价:

DeepSeek V4 是一款很强的文本与长上下文模型,开源属性和超长上下文都很有吸引力,但它并不是“全能王”,尤其在多模态、UI 场景和部分编程体验上,仍然有明确边界。

换句话说,它更像一把锋利但有指向性的刀,而不是一把什么都能干的瑞士军刀。

DeepSeek V4 到底更新了什么

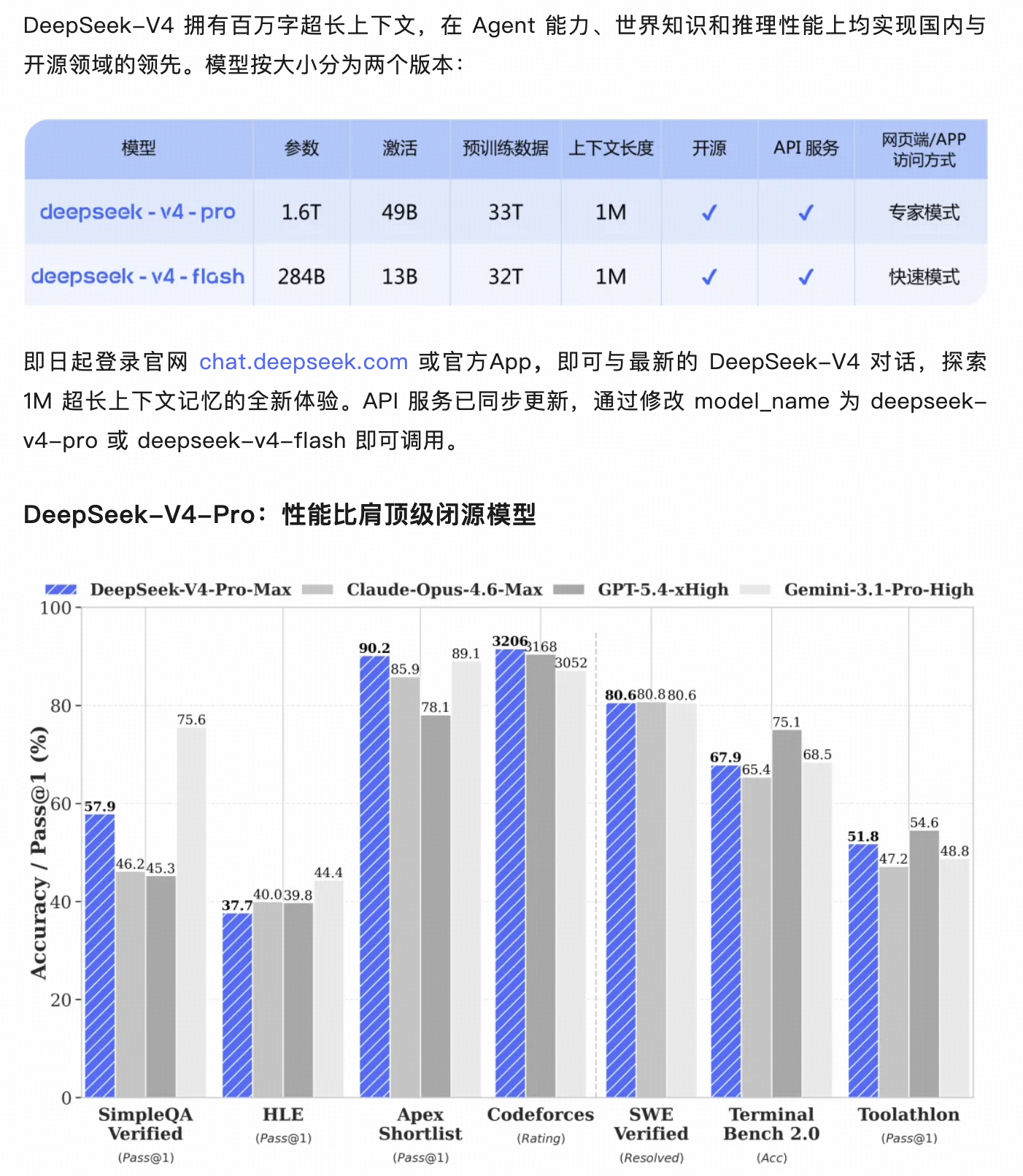

根据 DeepSeek 在 Hugging Face 上公开的模型卡,2026-04-24 这次放出的 DeepSeek-V4 系列主要有两个版本:

DeepSeek-V4-Pro:总参数1.6T,激活参数49BDeepSeek-V4-Flash:总参数284B,激活参数13B

两者都主打:

1M超长上下文MoE架构- 面向长文本和复杂任务的效率优化

官方还特别强调,V4 在百万 token 上下文下的推理效率做了重点优化,这一点其实很关键。因为很多模型嘴上都说自己上下文长,但一到超长文档分析、知识库问答、代码仓库理解这类真实任务里,速度和成本就会迅速暴露问题。

官方成绩看起来怎么样

从官方模型卡给出的 benchmark 来看,DeepSeek V4 的几个强项比较明确:

- 长上下文能力强

- 通识知识和中文表现不错

- Agent 类任务有竞争力

- 开源模型里位置很高

尤其是 DeepSeek-V4-Pro-Max,官方直接把它放到了和多家顶级闭源模型对比的位置上。从公布表格看,它在部分代码、长上下文、部分 agent 指标上已经非常接近第一梯队。

但要注意两点:

- 这是官方 benchmark,不等于所有真实场景都同样强

- “接近顶级”不等于“全面超越顶级”

所以判断它值不值得用,还是要看真实体验。

它的真实口碑是什么样

全球总排名

1. 大家最认可的是:开源、长上下文、文本能力

这是 DeepSeek V4 最容易被认同的部分。

原因不复杂:

- 开源可部署,天然有吸引力

- 超长上下文对文档分析、知识库、代码仓库理解很有价值

- 纯文本任务通常比多模态更容易稳定发挥

如果你的工作流本来就偏文本,比如:

- 写文档

- 总结材料

- 分析超长报告

- 处理知识库

- 做后端代码辅助

那么 DeepSeek V4 是有明显吸引力的。

2. 最明显的争议点:不支持多模态

这也是 V2EX 里最频繁出现的槽点之一。

帖子里有人直接问:“没有多模态,怎么写 UI?” 还有回复指出,不支持图片识别的话,很多依赖截图、页面还原、视觉检查的工作流都会打折。帖中后面的回复也提到一个很现实的问题:如果不能识图,那么很多基于浏览器或 Chrome MCP 的页面设计校验流程就不顺了。

这个判断我基本认同。

因为现在很多“编程”已经不只是纯代码补全了,而是包含:

- 看设计稿还原页面

- 对照截图改 CSS

- 检查布局细节

- 做 UI 对比

这类任务没有视觉输入,确实会难很多。你可以让别的多模态模型先把图片“转译”成文字,再交给 DeepSeek,但这套链路明显更麻烦。

所以如果你的核心需求是:

- 写前端页面

- 对设计稿做还原

- 做视觉验收

那 DeepSeek V4 不是最顺手的选择。

编程能力到底行不行

这部分的结论要更克制一点。

从官方 benchmark 看,V4 并不弱,甚至在一些代码和 agent 指标上已经很强;但从 V2EX 的实际反馈看,很多人并没有把它放在“编程体验第一梯队”的位置。

帖子里有比较直接的评价,认为它“编程弱于 Kimi K2.6 和 GLM 5.1”,也有人说“试了下编程领域不太行,其他还行”。不过同一帖子里,也有人反馈用 v4-flash 做小程序转 Vue PC 端的小需求,一次性完成度不错。

这说明一个很实际的问题:

DeepSeek V4 不是不能写代码,而是它更像“在不少编程任务上能做得不错,但未必总是最顺手的那一个”。

更具体一点,我会这样拆:

- 后端逻辑、脚本、小需求改造:可用,甚至可能很好用

- 大型前端、设计稿还原、视觉联调:受多模态缺失影响明显

- 高强度 agent coding:能打,但未必是体验最强的那一个

所以如果你是纯后端、平台开发、数据处理、自动化脚本用户,DeepSeek V4 的编程能力是够看的;但如果你是前端或全栈,而且强依赖视觉上下文,那它的短板会被放大。

本地部署这件事,别被“开源”两个字冲昏头

很多人一看到 DeepSeek 开源,第一反应就是“能不能本地部署”。

能,和“适合普通人本地部署”,是两回事。

V2EX 讨论里就有人直接泼冷水:1.6T 的参数规模,不太现实让普通个人用户真去本地扛。这个判断是合理的。因为对大多数开发者来说:

- 看到“开源”,会联想到“我自己就能跑”

- 但看到

1.6T,应该立刻想到“部署成本、显存和工程复杂度”

所以本地部署这件事更像:

- 企业级方案

- 云端托管方案

- 有预算团队的一体机方案

而不是普通笔记本用户的日常配置。

如果你只是想用能力,API 或云端接入通常更现实。

价格香不香

国内外主流大模型定价

国内外主流大模型 API 定价对比 (2026 年 4 月) · 单位: 元/百万 tokens · $1 ≈ ¥7.3

| 厂商 | 模型 | 输入(未命中) | 输出 | 缓存命中 |

|---|---|---|---|---|

| DeepSeek | V4 Flash | ¥1 | ¥2 | ¥0.2 |

| DeepSeek | V4 Pro | ¥12 | ¥24 | ¥1 |

| 阿里云 | Qwen3.5-Plus | ¥0.8 | ¥4.8 | ~¥0.4 |

| 阿里云 | Qwen3-Max | ¥2.5 | ¥10 | ~¥1.25 |

| 腾讯云 | 混元 HY3.0 Preview | ¥1.2 | ¥4 | ¥0.4 |

| 百度 | ERNIE 4.5 | ¥4 | ¥16 | — |

| 智谱 AI | GLM-5.1 | ¥8 | ¥28 | ~¥3.4 |

| 字节跳动 | 豆包 Seed-1.8 | ¥0.8 | ¥8 | — |

| 科大讯飞 | 星火 X2 | ¥3 | ¥3 | — |

| 月之暗面 | Kimi K2.5 | ¥4 | — | — |

| MiniMax | M2.5 | ¥2 | ¥8 | — |

| Anthropic | Claude Sonnet 4.6 | $3 (~¥22) | $15 (~¥110) | 含在价内 |

| Anthropic | Claude Opus 4.7 | $5 (~¥37) | $25 (~¥183) | 含在价内 |

| OpenAI | GPT-5.4 | $2.5 (~¥18) | $15 (~¥110) | $1.25 (~¥9) |

| OpenAI | GPT-5.5 ⚠️NEW | $5 (~¥37) | $30 (~¥219) | — |

帖子里有人整理了一个 2026 年 4 月 的大模型 API 价格对比。按照那份表,DeepSeek V4 Flash 的价格确实很有竞争力,而 V4 Pro 就没有那么“便宜到离谱”了。

结合讨论看,价格结论其实要分场景:

- 如果你拿它去和顶级闭源模型比,DeepSeek 还是便宜

- 如果你把它放进高频 coding 工作流里,账单依然会有感觉

- 如果后续没有更激进的 coding plan 或套餐,重度开发者对价格还是会敏感

这也是为什么有人说“速度有点慢,价格有点贵”,也有人反过来说“这个价格已经不算贵了”。

所以我对价格的判断是:

Flash 值得试,Pro 要看你到底是不是能把它的长上下文和强文本能力用满。

它最适合什么场景

如果让我给 DeepSeek V4 贴标签,我会把它放在下面这些高适配场景里:

- 超长文档总结与分析

- 知识库问答

- 长上下文代码仓库理解

- 中文问答与写作

- 后端代码辅助

- 企业私有化或半私有化部署评估

这些场景里,它的优势能比较完整地体现出来。

它不太适合什么场景

同样,也要把不适合说清楚:

- 强依赖图片理解的任务

- UI 还原和视觉验收

- 依赖设计稿驱动的前端开发

- 希望“本地轻松跑旗舰版”的个人用户

说白了,DeepSeek V4 的问题不是“不强”,而是“强得比较偏科”。

我对 DeepSeek V4 的最终评价

如果按产品视角打分,我会给 DeepSeek V4 一个很高但不满分的评价。

它最大的价值不只是“又出一个大模型”,而是:

- 开源旗舰继续往前推了一步

- 长上下文能力很有辨识度

- 在中文和文本密集场景里有现实价值

- 给企业部署和国产生态又加了一层想象空间

但它的短板也很现实:

- 缺少多模态,限制了前端和视觉类工作流

- 编程能力不差,但不一定是你最顺手的 coding 首选

- 真正的本地部署门槛依然很高

所以我的结论是:

如果你是做文本、知识库、后端、长上下文任务的,DeepSeek V4 很值得试,尤其值得关注 Flash 和后续生态接入;但如果你最在意的是前端 UI、图片理解、设计稿驱动开发,那它暂时还不是最优解。

结语

DeepSeek V4 不是那种“看一眼就知道赢麻了”的模型,也不是那种“完全不行”的模型。它更像一款边界非常清楚的强模型:在它擅长的地方,确实有硬实力;在它不擅长的地方,也确实会让人明显感觉到限制。

这反而是件好事。因为对真正用模型干活的人来说,最怕的不是模型有短板,而是大家分不清它的短板在哪。DeepSeek V4 现在的优缺点,其实已经越来越清楚了。

参考资料:

- V2EX 讨论帖:https://www.v2ex.com/t/1208225#reply34

- DeepSeek V4 模型卡:https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro